何やらまた新しいカテゴリーを始めてみました。

「統計学」でググったら、正直どういう記事が出てくるかって言うと、統計検定系の記事が多いんですよね。

やはり統計学関連で需要があるのは統計検定なのか!!

そんな身も蓋もない事実に気付いてしまったんですね。

※正直統計検定を持っていたからと言って、実務で役に立つかと言われると怪しいような気もするのですが、何はともあれ検定系の話題は需要があるみたいです!

スポンサーリンク

というわけで、ちょくちょく統計検定1級の解説記事でもあげていきます。

やはり1級ともなると中々難易度も高いようで、解説記事が少ないということと、難易度が高い割には公式があげている解説も略解すぎて解き方自体はよくわからないという問題点があるようです。

また、1級の解説記事を書いているブログも多少はあるようなのですが、何やらわざわざ一般解を証明してから具体的な数値を代入していたりして、全く試験であることを想定していない解答というか、多分記事書いている本人が解き方わからなかったから、一般的な証明をコピペしてきて、代入したんだろうなーというような解答が結構あったので、私の記事はリアリティある解答を心掛けていくつもりで書いていきます。

そして、少しずつ解説記事をあげてカテゴリーに突っ込んでいけば、Google検索からの訪問者数も増えるのでは!?という感じです笑

まあとりあえずやっていきますね。

というわけで、2017年 統計検定1級 統計数理 問1 対策用解説 を始めていきます。

2017年統計検定数理1級印象

まず、問題のpdfはコレ↓です。

http://www.toukei-kentei.jp/wp-content/uploads/201711grade1suri.pdf

ぱっと見た感じ、理系で統計学の授業を取っていた方なら、半分は解けそうだなあというくらいの印象は受けますね。

解答を読む限り、「証明せよ」という名言がないのであれば説明したり概要を述べたりする際の記述は簡単なもので良いようです(問1[4]など)。

問1の概要

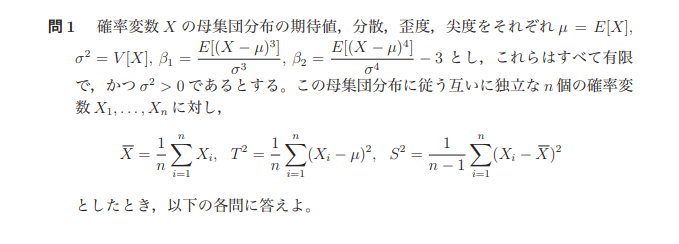

まず、問題のセットアップは次の通りです。

少なくとも4次のモーメントまでは存在する分布に従う確率変数を考えているようです。長々と書いて鬱陶しいなあと思う方のために、少し解説しておくと、確率変数の期待値、分散、歪度、尖度は必ずしも存在するとは限らないというところが、この問題文の肝になっています。

例えば コーシー分布 という分布があります。ちょっと不思議に思うかもしれませんが、この分布、期待値が存在しません。

ちなみに、期待値が存在しない場合、必ず分散は存在しません。分散が存在しない場合は必ず歪度も存在しません。歪度が存在しない場合は必ず尖度も存在しません。つまり、期待値が存在しない場合は分散も歪度も尖度も存在しません。

そういうわけで、問題文がこれだけ長くなっています。これくらいセットアップをしておかないと、中心極限定理やらなんやらの問題を出すときに面倒くさいんですね。

は標本平均ですね。標本平均は期待値の推定量として中々強い性質を持っていて、不偏であり、一致性ももっています。

は、期待値の真値

を知っているという仮定のもとでの分散の推定量ですね。非現実的な推定量だと思います。

は、分散の不偏推定量ですね。当然一致性も持ちます。一般的かつ初歩的な統計学の教科書では、まずこの推定量が分散の推定量として便利だよーといった話をします。ただ、本当にこの推定量が最適なのかどうかは少し考えなければなりません。

というのも、一昔前ならさておき、今の時代であればサンプルサイズを大きく取れる場合が多いので、一致性一本で攻めるべき場面も多く、不偏推定量であるよりも、一致性を満たす中で最小分散な推定量を見つけてくる方が良い場面もあるはずです。

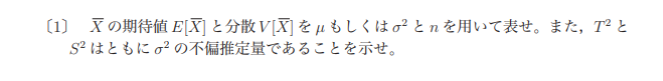

問1[1]

についてそれぞれ不偏性を示し、ついでに

の分散くらいなら秒で出るだろうから出しとけといった趣旨でしょうか。

これは期待値演算子の計算方法が分かっていれば簡単です。サックリ解いていきましょう。

まず、の期待値と分散について

期待値がだということはこの

は不偏推定量ですね。

ついでに、聞かれてはいませんが、nが大きくなると分散はより、殆ど0になりますね。つまり一致性が成り立ちます。

更にの期待値を考えます。

分散に関する不偏推定量であることがわかりますね。

最後にの期待値を考えます。

はい、ちょっと長かったですが不偏推定量であることが確認出来ました。

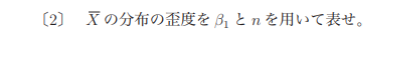

問1[2]

歪度の定義は書いてあるので、これもゴリゴリ計算するのみです。

が互いに独立であることに注意すると

ここ、ちょっとわかりにくいかもしれないので補足すると、,

とかを考えたところで、独立なので0になります。そのため3乗になってる部分しか残らないというわけです。

初見殺しだと思うかもしれませんが、方針を立ててから計算を始めればなんてことはありません。

モチベーションとしては、「3乗を展開したらダルそう」「でも、はなんとかしないと鬱陶しい」というところからスタートしています。

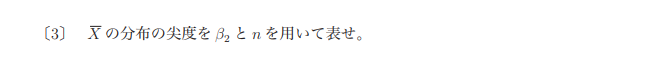

問1[3]

これはもう4乗になっているだけで[2]と全く同じ方針で解けます。

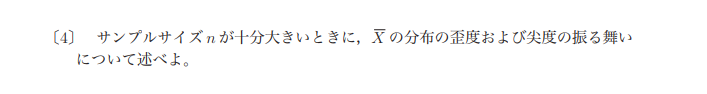

問1[4]

これも[2],[3]が正しく計算できていればほぼ自明ですね。分母にがあり、分子は仮定から有限なので、nが十分大きくなればほとんど0です。よって、歪度も尖度も0に向かいます。

公式の略解では中心極限定理についても言及していましたが、、問題文では歪度と尖度の振舞いについて述べよとのことでしたので、いらないような気がします。

問1[5]

最尤推定量は完全にボーナス問題ですね。なんせ、同時分布について対数取って微分してイコール0とおけば大体出てくるわけなので。一応やってみましょう。

この式がイコール0となるようなについて解き、その解を

とおくことにすると

ここでが未知であるとすると、

は

に関する最尤推定量を代入すればよく、この時の

の最尤推定量

は

とりあえず問1は以上になります。恐らくここはボーナス問題なので、解けないと合格はしんどそうですね。

次回は問2をやっていきます。

-

-

- キーワード---

-

統計検定1級 解説 数理 統計数理 2017年 解答