結構ブログ記事ではゴリゴリ統計学や機械学習の話を記事にしている私ですが、実は生粋の文系でして、数学も大学入学時点で数学ⅠAⅡBまでしかやっていませんでした。

今回はそんな私が一体どんな本を読んで勉強してきたら、こんな記事を書くまでになったのかを振り返るとともに、その際使った統計学・数学本を紹介していきたいと思います。

スポンサーリンク

【大学入学時】

能力的には数学ⅠAⅡBはある程度分かっているというレベルでした。数ⅢCは知りません。

まず、そんな状態でやったのはこれです。個人的にはド定番だと思ってます。

・コアテキスト

文系高校生レベルの数学的な知識のみで読みきることが出来て、かつ具体的にどう使うのかといった方面に着目した本です。大屋先生という日本でも有数の計量経済学者が書いた本なので、中身も信用できます。また、この本の演習本も出版されていて、それが下の本です。

・基本演習 統計学

大学レベルの数学・統計学で演習本は中々少ないので貴重ですね。

【統計検定を受けてみた】

コアテキストを一通り読みきるとどれくらいのレベルになるかというと、統計検定2級を受かる程度の力がつきます。実際私の大学では、コアテキストを終えた後に統計検定2級に関する広告が配られます。そこで私も受けてみました。その際に使用したテキストがこちらです。

・統計学基礎

ここまでやれば文系としては十分なくらい統計学の知識が身につきます。ついでに演習もはかどり、統計検定にも合格できるというオマケ付き。

【理系統計学に片足を突っ込む】

そろそろ文系レベルの統計学は卒業です。卒業にあたってどうしても数学的な知識をもう少しつける必要が生じました。しかし、数ⅢCをやっていない私はいきなり理系大学生用の数学本に手を出すことは出来ませんでした。そこで使用した本がこちらです。

・経済数学教室 確率論

この本は、

読者の想定が文系であるにもかかわらず、全て読み切れば相当高度なレベルまで確率論を学ぶことが出来ます。名著です。普通に買うと高いのですが、中古だとそこそこの額でおさまります。また、恐らく大学の図書館であれば絶対に置いてありますので借りるのもよいかと。

スポンサーリンク

もしくはこれですね

・確率論入門Ⅰ

確率論について基礎から丁寧に学ぶことが出来、こちらも大学レベルの確率論のそこそこのレベルまで到達できます。

その後に読んだ本がこちらです。

・統計学入門

理系用統計学の入門書です。ここまで読み進めてきた私としては平易でした。理系の大学生はこの本が統計学の勉強のスタートかなとは思います。ちなみにアクチュアリ試験や公認会計士試験の統計学もこのレベルです(公認会計士試験は、この本がオススメとは言われているけども、正直もう少し簡単なレベルで良いとは思う)。

【数理統計学の名著をあさる】

そろそろ本格的に統計学を学んでいく素地が出来上がっているはずです。そこで、少し数理的な側面の多い本を読んでいきました。

・明快演習数理統計学

この本は数理統計学とは書いてありますが、そこまで難しい内容ではありません。今まで固めた基礎の復習といった感じです。

・数理統計学

これは中々重たいですが、読み切れば力がつく名著です。有名なので、大学生であれば大学の図書館に行けば山ほどおいてあると思いますし、理系向けの中級レベルの統計学の講義では恐らくこの本が使われています。この時点で私は大学3年生でした。

・統計学

ちなみに、この時点で統計検定1級の勉強に突入出来るくらいの力はついているはずです。次に紹介する本も読んでしまえば、かなり

統計検定1級は合格圏内だと思います。

【そろそろガチめの統計学の勉強をはじめる】

大学4年生になった私はそろそろ、ガチめに勉強してみるかあと奮起し、洋書にも手を出すことにしました。洋書と聞くとハードルが高そうに感じますが、読み始めてみると、所詮専門書なので、難しい英語も無く、結構難なく読めちゃったりします。

・Statistical Inference

古い本ですが、これが一番おすすめです。体型的に伝統的な数理統計学の発展経緯を学ぶことが出来ます。

さらに次の本もオススメです。

・Theory of point estimation

世界的に有名なレーマンという統計学者の名著です。大学院レベルの統計学(点推定)を学ぶ上で定番の教科書です。

スポンサーリンク

・統計的検定論

同じくレーマンの名著で、統計的検定について一通り書いてある本の和訳本です。中古で買えば意外と安いですね。

【ベイズ統計学を学ぶ】

古い数理統計学から最近話題の機械学習へ学びを進めるにはベイズ統計学を学ばなければなりません。

さきほど紹介したS.D.Silveyのstatistical inferenceにもベイズの項目はサックリ書いていますが、あれだけでは流石に足りないので、補完する必要があります。

ベイズ入門の入門

・図解ベイズ統計学超入門

メチャメチャ

サックリ読めます。普通に1日で読み切れます。

ベイズ入門

・基礎からのベイズ統計学

難しい話はほとんどカットしているので非常に簡単です。読みやすいのでお勧め。これだけでベイズ統計学の基礎的な話はおしまいです。それだけベイズは

簡単でとっつきやすいということですかね。

・ベイジアン計量経済学

これは完全に

経済学部向けですが、この本も個人的にはオススメです。

特に

序盤のベイズの説明がわかりやすいうえに

そこそこ高度な内容までやるので、深く理解することが出来ます。

【数理統計学の流れを踏まえた上で機械学習にも足を踏み入れる】

ここまでやって、やっと今の時代のトピックスに移れますね。

・computer age statistical inference

現代統計学の有名人、Efron先生が書いた最新本です。

最新のトピックス(SVMやニューラルネット等)も取り扱っているうえに、

どういう歴史的な経緯をもって伝統的な数理統計学がここまで発展してきたのか時系列にそってじっくり書いてあります。

これで、過去のトピックスから現在のトピックスまでザックリ統計学の素地が身につくはずです!

私はそこそこ身につきました。

あとは、自分の興味に合わせて色々な分野の本を読んでみると更に補完することが出来ますし、ここまで読み進めて、最早読めない本などそうそうありませんし、もしあっても自ら掘り進める素地も出来ています。

こんな感じですね。

個別トピックの勉強プロセスについてはまたの機会にするとして、今回は統計学の素地をしっかり身に着けるために私が読んだ本について紹介しました。

何やらいっぱい紹介しましたが、いうてこれらの本は大学1年生から大学4年生までの4年間で読んだ本ですし、【理系に足突っ込んでみた】からここまでで約2年です。そう考えると、意外とそこまで量は無いのかな?とは思います。

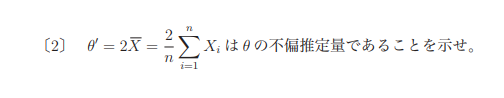

の近傍で定義されるため、

とし、

は

より大きいらしいということがわかったとします。

と

では異なっていそうですが、指数分布を仮定した場合、この二つは同値になります。このことを示します。